Case study FWOptimisation

MAIF : de 0 à 12 squads produit qui expérimentent.

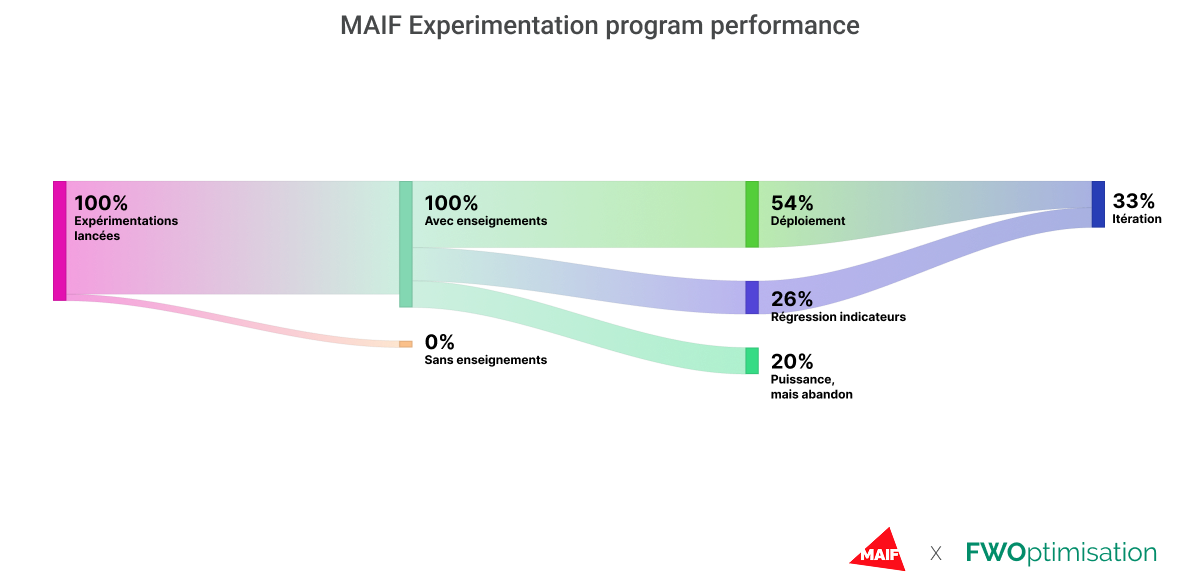

Comment la MAIF atteint +90% de tests exploitables, 55% de taux de victoires et a déployé la démarche dans son organisation produit ?

12

Squads produit qui expérimentent

+90%

Des tests A/B exploitables

54%

Taux de déploiement

+60

profils formés à l'expérimentation

Sommaire

Le défi : transformer une pratique isolée en culture d'expérimentation

En 2020, la MAIF me recrute pour développer leur programme d’expérimentation. Les Digital Analysts lançaient déjà des tests A/B de manière ponctuelle et c’était une première étape positive qui montrait l’intérêt du CRO à l’organisation.

Les tests A/B étaient lancés de manière aléatoire, sans lien systématique avec les OKRs des squads produit. Chaque Digital Analyst travaillait sur son périmètre, et il n’existait pas de Lead CRO pour structurer les outils, les processus, harmoniser les méthodes ou assurer la formation.

L’expérimentation restait perçue comme un « sujet data », pas comme un réflexe produit.

La MAIF avait la volonté et les premiers signaux positifs. Ce qui manquait, c’était la structure, la méthodologie et l’engagement collectif pour transformer cette pratique ponctuelle en capacité durable à l’échelle de l’organisation.

La Solution

Phase 1 : formation & groupe pilote

Démarrage avec 3 squads pilotes

FWOptimisation a accompagné 3 squads produit pour structurer leur démarche d’expérimentation. L’objectif : prouver que l’expérimentation, bien cadrée, accélère la création de valeur en évitant les erreurs coûteuses avant déploiement complet.

Coaching terrain quotidien

Après une formation complète des squads, on applique la théorie aux projets du quotidien : cadrage d’hypothèses, stratégie, design des solutions, lecture de résultats, décisions post-test. Chaque squad apprenait en faisant, sur ses vrais projets.

Vélocité hétérogène et facteurs bloquants

Durant ces premières années, la vélocité des équipes était très hétérogène. Plusieurs facteurs expliquaient ces écarts :

- Engagement du Product Manager : Certains PM portaient la démarche avec conviction, d’autres la percevaient comme une contrainte ou un ralentissement.

- Profils plus complexes à développer : Le développement des compétences et des nouvelles habitudes étaient hétérogènes, ce qui nous a amené à penser le recrutement différemment ou le coaching.

- Turnover : Rotation régulière des profils (notamment externes), ce qui obligeait à reformer continuellement les nouveaux arrivants.

- Gestion des budgets produit : Les budgets produit build/run/optimisation n’étaient pas encore adaptés. Les squads privilégiaient naturellement le « build » (nouvelles features) au détriment de l’optimisation continue.

Aligner les métiers et la communication aux squads

L’une des avancées majeures de cette phase a été d’aligner les métiers et la communication aux squads produit autour d’un objectif commun : l’expérimentation comme approche de validation systématique.

Le terrain était prêt pour déployer la démarche.

Phase 2 : structurer avant de déployer (2021-2023)

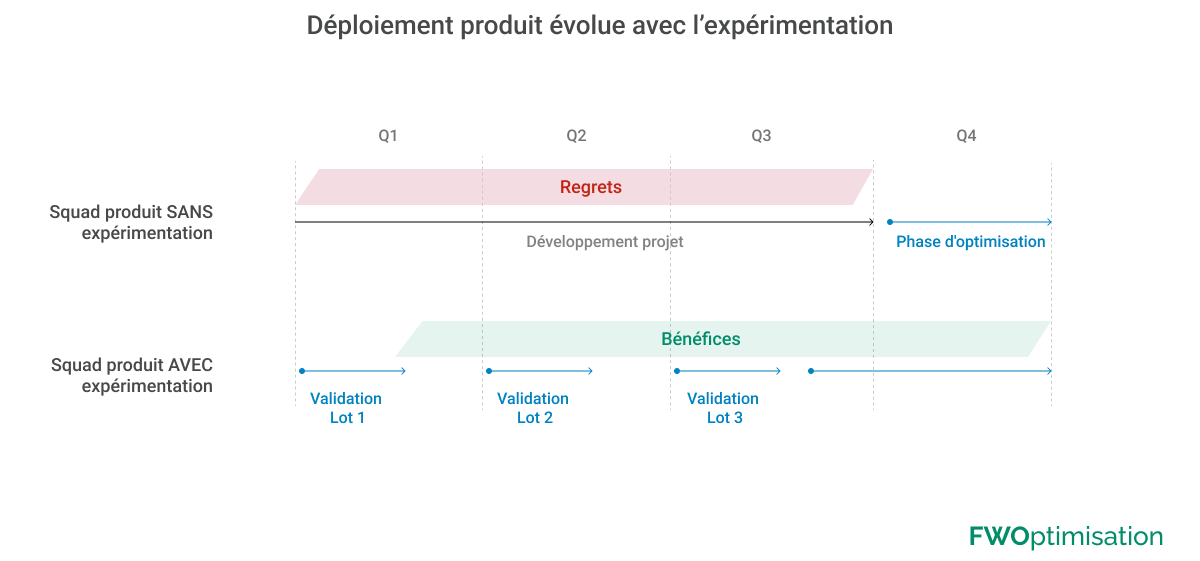

Le produit évolue : séquencement, validation et gestion de l’investissement des gros projets

La MAIF commence à mesurer et à valider le déploiement de ses features pour éviter les régressions et assurer sa croissance. Les PMs développent une gestion de l’investissement dans leurs projets en validant l’appétence des utilisateurs grâce aux smoke tests et en séquençant les développements.

Le premier cas était une refonte technique qui devait durer 9 mois et qui ne permettait pas de travailler l’objectif de croissance de la squad. La PM a proposé de développer le back-office et en parallèle de continuer à poser des hypothèses d’optimisation. Les hypothèses gagnantes ont été intégrées aux lots suivants.

Ce projet est devenu un cas d’école interne qui prouve que l’expérimentation peut fonctionner même sur des projets imposés lourds et techniques.

Changement visible dans les budgets des projets.

les budgets produit ont évolué pour intégrer une allocation spécifique à l’optimisation continue, en complément du build et du run, ce qui a permis de favoriser l’itération et de légitimer l’investissement sur l’amélioration de l’existant plutôt que de systématiquement arbitrer les nouvelles features.

Amélioration de l'impact des solutions et du design

Intégration systématique du copywriter

La copywriter a été intégré plus systématiquement dans la réflexion dès la phase de conception. Objectif : ne plus traiter le wording comme une variable secondaire, mais comme un levier d’optimisation à part entière.

Résultat : amélioration significative des taux de conversion sur les CTA, formulaires et pages produit.

Formation spécifique designers : « Comment le design impacte les résultats »

Une formation dédiée a été créée pour les UX et UI Designers, centrée sur l’impact mesurable du design sur les métriques business :

- Hiérarchie visuelle et diriger l’attention

- Friction cognitive, persuasion et conversion

- Comment écrire pour motiver

Cette formation a transformé la manière dont les designers concevaient leurs solutions : passage d’une logique « esthétique » à une logique « impact mesurable ».

Premier Lead CRO... qui part quelques mois après

Un premier Lead CRO interne a été formé pour structurer la démarche de manière transverse. Malheureusement, il a changé de mission quelques mois plus tard.

Cette difficulté a été un apprentissage clé : pour qu’un Lead CRO soit efficace, il faut non seulement le former techniquement, mais aussi s’assurer que son rôle soit durable et soutenu par la direction via une fiche de poste bien définie (salaire, missions, objectifs, …).

Phase 3 : autonomie & leadership interne (2022-2025)

Toutes les squads expérimentent et c'est un objectif individuel des PMs

Toutes les squads disposant du trafic nécessaire pour lancer des tests A/B statistiquement valides ont été formées. Total : 12 squads autonomes. Pour intégrer profondément la démarche, chaque PM a un objectif personnel de tests A/B à réaliser.

Un modèle centre d'excellence avec un nouveau Lead CRO : Jonathan Sainvet

En 2022, Jonathan Sainvet, Digital Analyst expérimenté, a été formé pour devenir le nouveau Lead CRO. Il a construit un modèle Centre d’Excellence :

- Chaque squad possède et lance ses propres expérimentations

- 1 Lead CRO (Jonathan) coach les 12 squads sur la qualité et la méthodologie

- 4 rôles formés dans chaque squad : DA + PM + UX Designer + UI Designer

Ce modèle permet de déployer un programme d’expérimentation facilement avec le bon accompagnement du lead CRO et évite le goulot d’étranglement ou la dépendance de l’équipe CRO centrale.

Processus d'intégration et de formation à l'expérimentation obligatoire

Pour éviter que les départs ne fassent perdre la compétence acquise, une formation à l’expérimentation systématique a été mise en place :

- 3 formations obligatoires pour tous nouveaux arrivants d’une squad produit :

- Formation data (Piano Analytics)

- Formation Contentsquare

- Formation complète à l’expérimentation

- 2 sessions par an pour absorber le flux continu d’arrivées

- Programme de certification pour valider l’acquisition des compétences

- Coaching de suivi après la formation pour assurer l’application terrain

Cette formation systématique a résolu le problème du turnover : les nouveaux sont opérationnels dans les 3 mois suivant leur arrivée. La capacité ne part plus avec les départs.

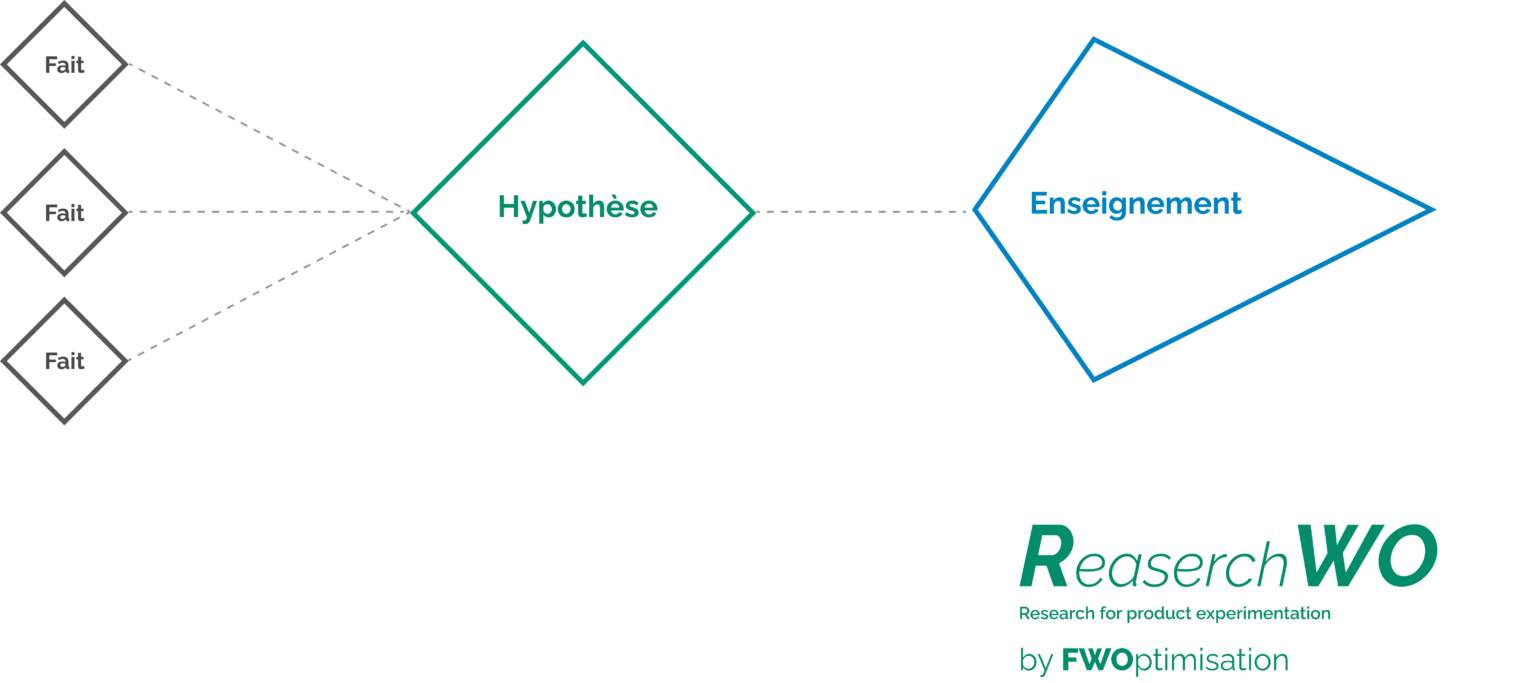

Structurer la discovery produit avec le framework ResearchWO

Pour structurer la discovery, faciliter la montée en compétences et garantir la qualité des hypothèses, le framework ResearchWO a été déployé :

- Etape 1 – Diverger : Générer des questions exploratoires et priorisation de la recherche

- Etape 2 – Découvrir : Collecte et analyse quali + quanti en parallèle

- Etape 3 – Corréler : Détecter les signaux faibles pour construire des hypothèses solides

- Etape 4 – Stratégie : Définir une stratégie de déploiement avec un arbre d’opportunités priorisé

Lors de workshops de recherche, les squads développent la qualité des analyses et les « hypothèses de surface » sans valeurs sont tuées avant qu’elles ne gaspillent de la bande passante de tests, précieuse dans un contexte banque / assurance.

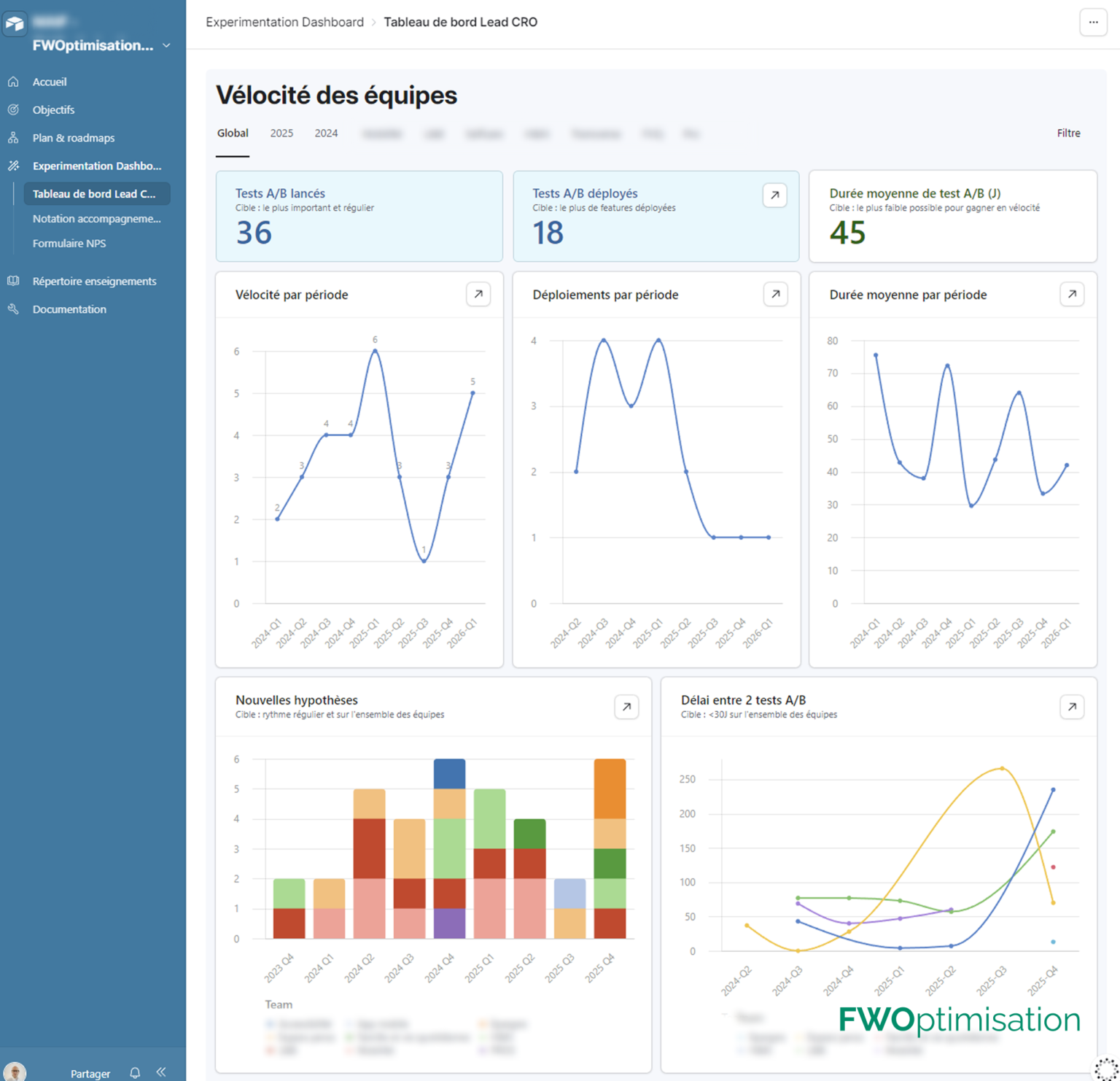

Outil de suivi de performance des squads

Un outil de suivi de performance a été mis en place pour monitorer l’efficacité de chaque squad et permettre d’accompagner de manière ciblée les nouveaux profils et squads dans l’atteinte de leurs OKRs :

+20 métriques suivies automatiquement :

- Nombre de tests lancés / trimestre

- Taux de tests exploitables

- Taux de victoires

- Délai moyen discovery → lancement

- Vélocité d’itération post-test

- …

Utilisation :

- Discussion trimestrielle avec les leaders de chaque métier (Produit, Data, Design) pour définir des opportunités d’amélioration

- Identification des squads en difficulté

- Ajustement de l’accompagnement par le Lead CRO

Les résultats

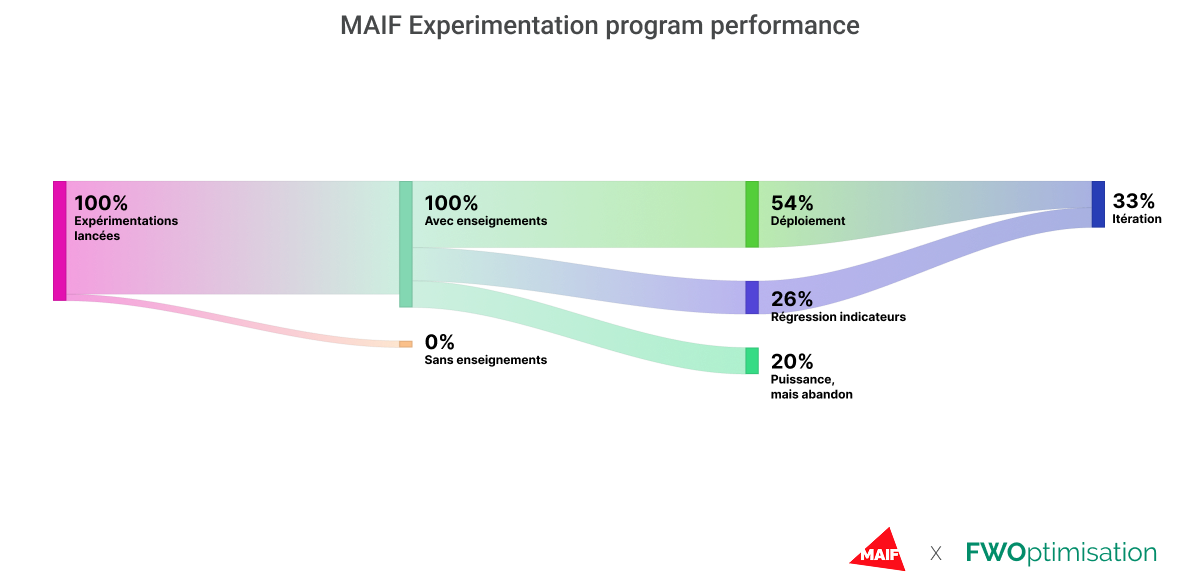

Métriques du programme d’expérimentation

| Metrics | MAIF | Moyenne marché | Ecart |

| Taux tests non-neutres | +90% | 30-60% | 2-3x supérieur |

| Taux de victoires | 54% | 10-15% | 3-5x supérieur |

| Temps discovery | 1.5 mois env. | Plusieurs sem. à mois | ~50% plus rapide |

| Tests par an | +20 | Variable | Vélocité constante |

Ces chiffres n’arrivent pas par hasard. Ils sont le résultat de :

- Formation systématique des squads (pas ponctuelle)

- Discipline de la discovery (ResearchWO) et du processus

- Coaching de qualité par le lead CRO

- Culture qui traite les échecs comme des données, pas problèmes

Exemple n°1 : créer de la croissance en vendant autrement

Une squad souhaite vendre un produit complémentaire dans le parcours d’achat du produit principal. Le risque est de pénaliser le produit principal, bien plus rentable.

La squad teste les 2 parcours en parallèle et les résultats sont inattendus :

- Gain des ventes croisées

- Aucun impact sur les souscriptions du produit principal

- Approche validée et déployée sur autres squads

C’est la différence entre « espérer que ça marche » et « savoir que ça marche ».

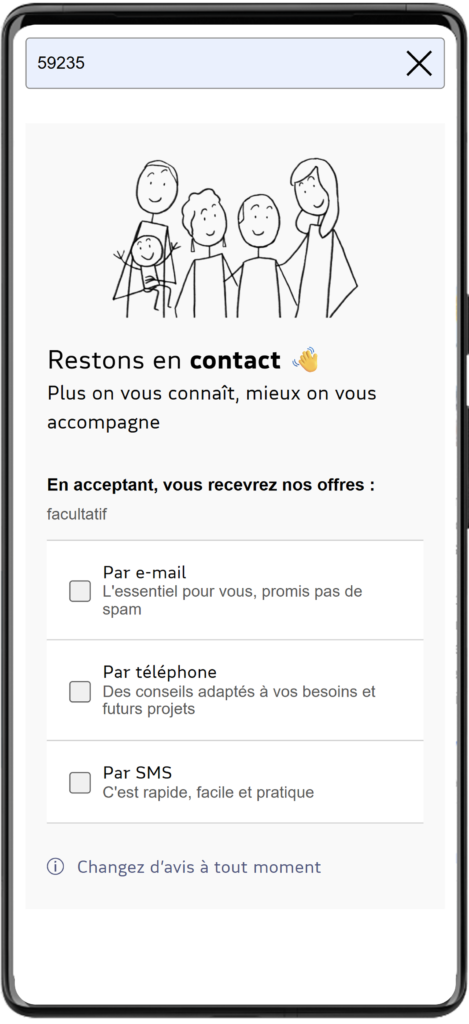

Exemple n°2 : Opt-ins prospects : de l’échec aux gains de +49%

Contexte : Améliorer la collecte de consentements prospects (email, téléphone, SMS) au moment du devis.

Première itération = échec

- Opt-ins email : -43%

- Opt-ins SMS : -7%

- Opt-ins téléphone : +95%

Deuxième itération = victoire

- Opt-ins email : +5%

- Opt-ins téléphone : +49%

- Opt-ins SMS : +38%

Leçon : L’échec de la première itération est normal. Apprendre et itérer est ce qui sépare les programmes matures des immatures. À la MAIF, l’échec n’est plus un problème—c’est de la donnée.

Enseignements clés

1. Construire un modèle durable, pas une dépendance

Lead CRO interne + squads formées = capacité permanente.

FWOptimisation coach, la MAIF exécute. Pas de régie, pas de dépendance consultants.

Le modèle scale parce que la compétence reste dans l’organisation.

Attention : le Lead CRO doit être engagé sur la durée et soutenu par la direction.

2. L’excellence méthodologique n’arrive pas par hasard

MAIF atteint 90% de tests exploitables (vs 67% marché) et 55% de taux de victoires (vs 10-15% marché). Ces résultats exceptionnels sont le fruit de : formation systématique + discipline du framework ResearchWO + coaching qualité quotidien + design review intégrée. Un langage commun élimine la réinvention de la roue par chaque squad.

3. Formation systématique obligatoire

Pas optionnelle. Pas pour volontaires. Tout le monde est formé dans les 3 mois suivant l’arrivée. 2 cohortes par an pour gérer flux continu de recrutements. Cette systématisation résout le problème du turnover : la compétence ne part plus avec les départs.

4. Mesure de l’impact business = buy-in leadership

Outil de suivi de performance + dashboard impact financier. 712K€ CA annuel mesuré à la MAIF. Sans chiffres visibles et partagés, pas d’adhésion du leadership. Les données parlent plus fort que les arguments.

5. La collaboration inter-squads amplifie l’impact

Point mensuel avec 30+ participants maintenu depuis 2019. Capitalisation collective sur les apprentissages. Harmonisation des bonnes pratiques. Maintien de la motivation. Ce rituel transforme l’expérimentation d’une pratique individuelle en capacité organisationnelle. Pilier du changement culturel.

6. La culture d’apprentissage bat la culture de réussite immédiate

L’exemple opt-ins (-43% → +49% entre V1 et V2) prouve qu’échouer en V1 est normal. Ce qui compte : apprendre, itérer, retester. À la MAIF, l’échec d’un test n’est plus un problème – c’est une étape. Les équipes itèrent sur base d’apprentissages, pas d’opinions. Le droit à l’échec est explicite et assumé.

7. L’organisation doit suivre

RH (onboarding), budgets (build/run/optimisation), process (design review) — tout doit s’aligner pour soutenir la pratique. Le droit à l’échec doit être explicite, pas implicite. Sans ces adaptations organisationnelles, même la meilleure formation échoue.

Vous voulez des résultats similaires ?

La MAIF prouve qu’on peut construire une culture d’expérimentation même dans des secteurs conservateurs. Contactez moi pour un diagnostic de votre programme d’expérimentation.

Je peux vous aider à :

- Construire la capacité d’expérimentation de vos équipes produit ou CRO

- Structurer votre discovery et améliorer l’impact de vos hypothèses avec le framework ResearchWO

- Former et coacher votre Lead CRO pour développer son impact dans l’organisation

- Déployer de 1 à 10+ squads qui expérimentent avec efficacité

- Transformer la culture de l’opinion vers la donnée

Autres clients : Kiabi, Decathlon, Boulanger, Société Générale, BNP Paribas

Vous voulez des résultats similaires ?

La MAIF prouve qu’on peut construire une culture d’expérimentation même dans des secteurs conservateurs. Contactez moi pour un diagnostic de votre programme d’expérimentation.

Je peux vous aider à :

- Construire la capacité d’expérimentation de vos équipes produit ou CRO

- Structurer votre discovery et améliorer l’impact de vos hypothèses avec le framework ResearchWO

- Former et coacher votre Lead CRO pour développer son impact dans l’organisation

- Déployer de 1 à 10+ squads qui expérimentent avec efficacité

- Transformer la culture de l’opinion vers la donnée

Autres clients : Kiabi, Decathlon, Boulanger, Société Générale, BNP Paribas

Questions communes

FAQ

Combien de temps faut-il pour transformer un programme d'expérimentation ?

Chez la MAIF, la transformation complète — de 3 équipes pilotes à 12 squads autonomes — a pris 6 ans. Les premiers résultats tangibles sont visibles dès la fin de la première année.

Est-ce qu'une grande organisation peut développer une culture d'expérimentation sans agence externe ?

Oui, c’est même l’objectif. L’accompagnement FWOptimisation vise explicitement l’autonomie des équipes, pas la dépendance à un prestataire.

Qu'est-ce que le framework ResearchWO ?

Une méthode développée par FWOptimisation qui permet de structurer la discovery et de réunir le monde produit, la data et l’UX.

Il se déroule en 4 phases (diverger, découvrir, corréler, construire) pour transformer les données en hypothèses précises et une stratégie actionnables par les squads (arbre d’opportunités).

Comment mesure-t-on l'impact financier de l'expérimentation ?

Un dashboard dédié sous Airtable permet de suivre la performance des équipes produit de la MAIF, leurs impacts, la rapidité d’exécution et la qualité des hypothèses.