Calculateur ROI programme d'expérimentation : projection chiffrée et corrigée de vos tests A/B

Le seul calculateur qui permet d’estimer le gain de son programme d’expérimentation qui applique la correction Winner’s Curse pour déterminer l’impact de vos tests A/B.

- Projection sur 12 à 36 mois corrigée du biais de sélection

- Prend en compte les pertes évitées par les décisions bloquées

- Rapport CODIR en 5 minutes, exportable en PDF

- 100 % côté navigateur — aucune donnée stockée

Comment quantifier la valeur d’un programme de test A/B ?

Les directions marketing et produit font face à un défi récurrent : justifier l’investissement dans un programme d’expérimentation face à un CODIR ou un CFO qui attend des chiffres précis et défendables. Les projections naïves, multiplier un uplift observé par le trafic mensuel, surestiment systématiquement le ROI réel d’un programme CRO. Les chiffres affichés en interne ne tiennent pas la critique d’un comité d’investissement rigoureux.

Une méthodologie solide pour projeter la valeur d’un programme d’expérimentation A/B exige trois corrections complémentaires :

- la correction du biais de sélection statistique (Winner’s Curse)

- la modélisation de la décroissance des gains dans le temps

- la quantification des pertes évitées grâce aux décisions bloquées par les tests négatifs.

Cet outil applique ces trois corrections sur un modèle transparent et documenté, pour produire une projection chiffrée et défendable sur 12 à 36 mois.

Winner’s Curse : pourquoi les projections naïves surestiment le ROI

Le Winner’s Curse est un biais statistique bien documenté qui affecte les tests A/B significatifs. Un test qui franchit le seuil de p < 0,05 a tendance à surestimer son vrai uplift, c’est une propriété mathématique du processus de filtrage des tests. Plus un test est sous-puissant (sample size limité, MDE étroit), plus la surestimation est forte.

Lee et Shen (ACM SIGKDD, 2018) ont proposé une correction statistique élégante : WC = max(0, uplift − σ · φ(b − z)), où φ est la densité normale standard, b le seuil de significativité et z le ratio signal-to-noise. Cette correction réduit typiquement les uplifts déclarés de 15 à 30 %, et davantage pour les tests faiblement puissants.

Le calculateur applique cette correction sur chaque test individuel de votre frise, en tenant compte du type de métrique (conversion, AOV, taux de retour, support, ops) et du trafic effectif partagé entre tests simultanés.

Le résultat : une projection qui résiste à un challenge méthodologique en CODIR.

Décisions bloquées : la valeur cachée de l’expérimentation

Souvent, la moitié de la valeur d’un programme CRO mature ne se trouve pas dans les tests gagnants déployés, mais dans les décisions coûteuses qu’on a su éviter grâce au testing. Une refonte checkout qui aurait détruit 800 K€ par mois de chiffre d’affaires, un outil tiers (..), ces « features bloquées » sont rarement chiffrées dans les projections.

Cet outil intègre explicitement les décisions bloquées dans le calcul de la valeur nette du programme. Chaque décision bloquée représente une perte mensuelle évitée, multipliée par la durée de vie estimée du gain pour obtenir la perte totale évitée sur l’horizon de projection. La valeur nette du programme additionne donc les gains des tests A/B (corrigés Winner’s Curse) et les pertes évitées documentées, une formule simple, additive, et entièrement défendable.

Comment présenter votre business case CRO au CODIR

Un CODIR sceptique posera trois questions classiques :

- quel est le ROI ?

- d’où viennent les chiffres ?

- quelles sont les hypothèses ?

Cet outil répond aux trois en délivrant un ROI annualisé corrigé statistiquement, des sources académiques citées (Lee & Shen 2018, Kohavi 2020, Amazon Science 2023), et une section « Limites et précautions » qui documente explicitement les hypothèses méthodologiques.

Pour une présentation efficace, structurez votre pitch en trois temps :

- le chiffre headline (valeur nette du programme)

- la méthodologie rigoureuse appliquée

- les limites assumées et le plan de recalibrage. Cette transparence méthodologique augmente la crédibilité face à un CFO technique.

0 €

générés par le programme · Correction WC appliquée (Lee & Shen, KDD 2018)

Cet outil ne prétend pas prédire l'avenir avec exactitude — les uplifts futurs sont par nature incertains, le contexte business évolue, et un programme CRO se transforme sur 36 mois. Il sert à éclairer une décision stratégique : démontrer qu'un programme d'expérimentation rigoureux protège l'organisation autant qu'il génère des gains, et que les petites victoires accumulées par le testing systématique créent davantage de valeur long terme qu'un déploiement aveugle.

L'outil signale automatiquement les tests dont la fiabilité mérite vérification (icônes ⓘ ou ⚠ dans la frise). Calculer un sample size →

La vraie valeur de votre programme se mesure a posteriori, avec des holdouts et du causal impact. Cette projection est l'outil pour défendre votre budget aujourd'hui et recalibrer vos hypothèses à chaque trimestre.

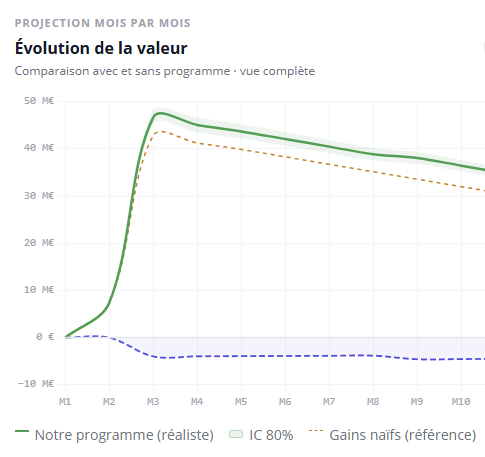

Évolution de la valeur

Performance projetée du programme · zoom sur les gains

Mensuel : valeur produite chaque mois, après application de la décroissance par type. Pratique pour visualiser la dynamique du programme.

Cumulatif : somme progressive de la valeur mois après mois. Pratique pour communiquer un total à un CFO ou un CODIR.

Les deux vues affichent la même valeur totale au dernier mois — c'est juste une question d'angle de présentation.

Linéaire : décroissance régulière sur la durée de vie configurée (mois 1 → 100%, dernier mois → 0%). Mode prudent.

Équilibré : décroissance avec plateau résiduel par type (15% tweaks UI, 50% flows structurels, 85% ops). Plus défendable scientifiquement.

Réf. : Amazon Science, "Measuring long-term effects of experimentation", 2023.

Votre programme génère de la valeur réelle corrigée du Winner's Curse — c'est l'honnêteté statistique qui protège votre business case contre la surestimation classique.

Sans votre démarche, l'organisation aurait sorti les gains naïfs mais aurait aussi déployé les décisions coûteuses bloquées. Le solde net peut être fortement négatif.

Paramètres globaux

Plan de test

Positionnez vos tests A/B sur l'horizon. Cliquez sur une ligne pour éditer ses paramètres dans le panneau à droite.

Sélectionnez un test ou une décision dans la frise pour modifier ses paramètres.

Correction du biais de sélection (Winner's Curse)

Un test A/B qui franchit le seuil de significativité a tendance à surestimer son vrai uplift — c'est le Winner's Curse. Plus le test est sous-puissant, plus la surestimation est forte.

WC = max(0, uplift − σ · φ(b − z))

Où φ est la densité normale standard, b = 1.645 (seuil unilatéral 95%), z = uplift/σ (signal-to-noise ratio).

Source : Lee & Shen, "Winners Curse — Bias Estimation for Total Effects of Features in Online Controlled Experiments", ACM SIGKDD, 2018.

Erreur d'estimation σ par type de métrique

| Type | Formule σ | Modèle |

|---|---|---|

| Conversion | √(2(1−CR) / (n_arm · CR)) |

Binomial |

| AOV | CV / √(n_arm · CR) |

Normal (CV) |

| Retour | √(2·RR·(1−RR) / n_orders) / RR |

Binomial |

| Support | CV / √(n_arm · tpM/traffic) |

Normal (CV) |

| Ops | CV / √(trM · dur / 2) |

Normal (CV) |

n_arm = trafic effectif / 2. Le trafic effectif est divisé par le nombre de tests simultanés, mois par mois.

Décroissance avec plateau résiduel

gain(t) = gain₀ × (plateau + (1 − plateau) × max(0, 1 − (t−1)/(ls−1)))

| Type de test | Durée de vie | Plateau défaut |

|---|---|---|

| Tweak UI | 3–6 mois | 15% |

| Copy / messaging | 6–12 mois | 20% |

| Flow / UX structurel | 12–24 mois | 50% |

| Personnalisation | 24–36 mois | 60% |

| Support / ops | permanent | 85% |

Référence : Amazon Science, "Measuring the long-term effects of experimentation", 2023.

Calibrage du prior τ (shrinkage)

shrinkage = τ² / (τ² + σ²)

τ est l'écart-type a priori des vrais uplifts dans votre programme. Plus τ est bas, plus le shrinkage est agressif. La calibration empirique consiste à calculer l'écart-type des uplifts observés sur vos 20 derniers tests déployés.

| Situation | τ recommandé |

|---|---|

| Programme démarrant | 3–5% |

| Tests structurels (checkout) | 6–8% |

| Tweaks UI mineurs | 2–3% |

| Grands groupes matures | 4–6% |

| Programme mature (50+ tests) | calculer |

Référence : Kohavi, Tang, Xu. "Trustworthy Online Controlled Experiments", Cambridge University Press, 2020, chapitre 18.

Pourquoi projeter les gains d'un programme A/B ?

Une projection chiffrée de votre programme d'expérimentation n'est jamais totalement juste. Les uplifts des tests futurs sont incertains par construction. Le contexte business évolue. Un programme mature change radicalement en 18 mois. Alors pourquoi cet outil ?

Cet outil sert à éclairer une décision stratégique plutôt qu'à prédire un futur exact. Il répond à 4 questions concrètes :

2. Les petites victoires accumulées valent-elles le coup ? Un programme mature accumule 50 tests à +1-3%. Cette accumulation crée une valeur cumulée importante sur 12-36 mois.

3. La culture d'expérimentation protège-t-elle l'entreprise ? La moitié de la valeur vient des mauvaises décisions évitées grâce au testing.

4. Comment recalibrer le programme ? Comparez projection et mesure réelle trimestriellement. Recalibrez τ et les plateaux.

Qu'est-ce que ce calculateur ?

Ce calculateur produit une projection chiffrée et défendable de la valeur générée par votre programme d'expérimentation A/B sur 12 à 36 mois. Il s'adresse aux Heads of CRO, Product Managers, Heads of Growth et Directeurs Marketing qui doivent justifier un investissement CRO devant un CODIR ou un CFO.

• Un montant en € de gains projetés sur l'horizon

• Un ROI annualisé du programme

• La valeur des décisions bloquées par l'expérimentation

• Un graphique de projection mois par mois

Comment l'utiliser en 5 minutes

| 1 | Sélectionnez votre contexte dans le select en haut des paramètres (Startup / E-com mid / Grand groupe / B2B SaaS) |

|---|---|

| 2 | Ajustez les 3 champs essentiels : trafic mensuel, AOV (ou LTV pour SaaS), horizon |

| 3 | Ajoutez vos tests A/B planifiés dans la frise calendaire avec leurs hypothèses d'uplift |

| 4 | Ajoutez les décisions bloquées par l'expérimentation |

| 5 | Lisez les 4 KPI cards en haut pour le résumé exécutif |

| 6 | Présentez le rapport en mode CODIR ou exportez en PDF |

Comment calibrer vos paramètres

| Paramètre | Comment le trouver |

|---|---|

| Trafic mensuel | GA4 : Rapports > Acquisition > Trafic total sur 30 jours |

| AOV / LTV | E-commerce = CA/commandes, SaaS = LTV client sur cohortes matures |

| Coût programme / an | Salaires équipe CRO + outils (plateforme de test, analytics) + agence |

| Prior τ | Écart-type des uplifts observés de vos 20 derniers tests déployés |

| Durée de vie | Par type de test — voir le preset affiché dans l'éditeur |

| Plateau résiduel | Conventions sectorielles (15% tweaks UI, 85% ops) |

Questions fréquentes

Pourquoi mon ROI affiché est-il plus bas que mes projections internes ?

Parce que cet outil applique la correction Winner's Curse, qui réduit les uplifts déclarés de 15-30% pour refléter le biais de sélection des tests significatifs.

Pourquoi ne pas inclure les gains des tests négatifs ?

Les tests négatifs sont comptés dans les « décisions bloquées » — leur valeur est la perte évitée en ne déployant pas.

Comment justifier la valeur des décisions bloquées au CFO ?

Documentez chaque décision bloquée avec : date, hypothèse testée, résultat du test, projection du CA perdu si déployée. Cf. méthodologie Lukas Vermeer (Booking.com).

Pourquoi 80% d'IC et pas 95% ?

80% est plus pertinent pour la prise de décision business. 95% est trop conservateur pour des projections stratégiques.

Pourquoi le plateau résiduel ne tombe-t-il jamais à zéro ?

Empiriquement, les gains structurels persistent (effet d'habitude, réduction durable de friction). Référence : Amazon Science 2023.

Que faire si je n'ai pas encore de tests passés pour calibrer τ ?

Utilisez la valeur par défaut du preset (3-10% selon le contexte). Recalibrez après vos 20 premiers tests.

Comment l'outil gère-t-il le partage de trafic entre tests simultanés ?

Le trafic effectif par test = trafic mensuel ÷ nombre de tests simultanés ce mois-ci.

Puis-je utiliser cet outil pour un programme de personnalisation ?

Oui, mais avec prudence. La personnalisation a une dynamique de gain différente (plus de variance entre segments).

L'outil est-il adapté pour les sites à faible trafic (< 10K/mois) ?

Partiellement. La correction WC mord très fort sur les tests sous-puissants. Regardez la bannière de statut de puissance dans l'éditeur.

Mes données sont-elles stockées ?

Non. Tous les calculs sont 100% côté navigateur. Aucune donnée ne sort de votre machine. Pas de cookies, pas de tracking.

Méthodologie détaillée

Pour le détail technique complet des formules, des corrections statistiques et des sources académiques, consultez l'onglet Méthodologie.

Limites et précautions méthodologiques

Cet outil produit une projection — pas une prévision certifiée. Les résultats dépendent de plusieurs hypothèses dont la précision varie entre ±15% et ±40% selon votre contexte.

• Applique la correction Winner's Curse (Lee & Shen 2018), état de l'art

• Modélise la persistance des gains avec plateau résiduel par type

• Intègre la valeur des décisions bloquées

• Différencie 7 types de métriques avec des formules σ adaptées

1. Le prior τ est une estimation. Le shrinkage peut sur-corriger ou sous-corriger de 15-30% selon le τ choisi.

2. Les plateaux résiduels sont des conventions. Ajustez selon votre contexte (maturité, fréquence des refontes).

3. Les décisions bloquées sont déclaratives. Documentez chaque décision avec preuves pour la traçabilité.

4. L'horizon 36 mois est long. Préférez des recalibrages fréquents (tous les 6 mois).

5. La correction WC est optimale pour un test isolé. Sur un portefeuille, c'est néanmoins meilleur qu'une projection naïve.

6. Pas de stress test intégré. Recalculez avec τ ±2pts, plateaux ±10pts pour la fourchette.

• Business case défendable au CODIR

• Comparer des scénarios (budget haut vs bas)

• Justifier un investissement CRO

• Garantir un ROI précis à ±5%

• Fixer des OKR individuels

• Remplacer la mesure post-déploiement

La vraie valeur se mesure a posteriori (HoldOut tests, Universal Holdouts, Causal Impact). Ce calculateur est un outil de projection ex-ante pour justifier l'investissement. À chaque trimestre, comparez projections et gains mesurés. Recalibrez τ et les plateaux.

Vérifier la fiabilité d'un test avant de projeter

Cette projection part d'une hypothèse forte : que vos tests vont effectivement détecter les uplifts attendus. L'outil signale les configurations qui présentent des signaux de fragilité typiques.

• Test court (< 2 mois) : exposition probablement insuffisante

• Trafic global limité (< 100K/mois)

• Tests simultanés multiples (≥ 3) : sample size divisé

• Baseline conversion faible (< 1%)

Quand 2+ signaux convergent, l'outil affiche une bannière d'alerte. Pour un calcul rigoureux du sample size minimal, utilisez le calculateur MDE dédié.